Signaltheorie der Intelligenz

für das Human Brain Projekt der Europäischen Union

1 Grundlagen zur Signaltheorie

1. Grundlagen

1.1 Historische Einordnung

Natürliche Intelligenz entsteht durch die Arbeit von Nervenzellen. Künstliche Intelligenz wurde von diesen biologischen Prinzipien inspiriert.

Die Erforschung der neuronalen Signalverarbeitung begann mit der Entdeckung der Aktionspotentiale und der Leitung über Axone. Otto Loewi zeigte 1921 erstmals die chemische Natur der Signalübertragung durch Neurotransmitter. John Eccles beschrieb die exzitatorischen und inhibitorischen Mechanismen der synaptischen Integration. Donald Hebb formulierte 1949 die Lernregel, die bis heute als Grundlage für neuronale Plastizität gilt. Parallel dazu entwickelten McCulloch und Pitts (1943) das erste formale Modell künstlicher Neuronen, gefolgt vom Perzeptron (Rosenblatt, 1958). Es beruhte auf künstlichen Neuronen, deren Funktionsweise sich an den elementaren Eigenschaften biologischer Nervenzellen orientierte. Diese Grundeigenschaften bilden bis heute die gemeinsame Basis für Neurologie und KI.

Grundeigenschaften von Neuronen

Reale Neuronen sind Signalverarbeiter. Sie empfangen Eingaben von Rezeptoren oder anderen Neuronen und kommunizieren über zwei Formen elektrischer Aktivität:

- Membranpotentiale (subthreshold excitations), die unterschwellige Erregungen darstellen,

- Aktionspotentiale, die als energiesparende Signalform eine zentrale Rolle spielen – gerade im Vergleich zum enormen Energiebedarf heutiger KI-Systeme.

Die elementaren Funktionen von Neuronen lassen sich wie folgt zusammenfassen:

- Signalweiterleitung: Neuronen leiten Signale entlang ihrer Axone weiter und können dabei die Art des verwendeten Neurotransmitters wechseln.

- Konvergenz: Mehrere Eingänge werden zusammengefasst, wodurch rezeptive Felder und Mittelwertneuronen entstehen.

- Divergenz: Ein Ausgangssignal kann auf viele Zielneuronen verteilt werden; Divergenzmodule im Gehirn sichern die breite Signalverteilung.

- Modulation: Neuronen wirken erregend oder hemmend auf andere Neuronen und modulieren deren Ausgangssignal.

- Speicherung: Durch synaptische Plastizität (Hebbsches Lernen, LTP/LTD) verändern Neuronen die Stärke ihrer synaptischen Verbindungen – kurzzeitig oder dauerhaft – und speichern damit Signalverläufe.

- Signalinversion: Neuronen können Mittelwertsignale hemmen, wodurch sich der Verlauf der Signalstärke umkehrt (Monotonieumkehr).

Diese knappe Übersicht soll genügen. Sie verdeutlicht, dass die elementaren Signalverarbeitungsfunktionen biologischer Neuronen sowohl das Fundament der Neurologie als auch die Inspirationsquelle für künstliche neuronale Netze bilden. Für künstliche Neuronen, die in künstlichen neuronalen Netzen als Knoten bezeichnet werden, wurden viele Eigenschaften von künstlichen Neuronen übernommen und teils vereinfacht.

Signalerkennung durch Neuronen

Reale und künstliche Neuronen können Signale erkennen, die sie über ihre Synapsen empfangen. Hat ein Neuron n Synapsen, so kann sein Input als Vektor mit n Komponenten interpretiert werden. Jeder Synapse wird ein Gewicht zugeordnet, welches bestimmt, mit welcher Stärke die zugehörige Signalkomponente des Inputvektors am Output beteiligt ist. Da das Neuron n Synapsen hat, besitzt es ebenfalls n Gewichte. Diese bilden den Gewichtsvektor.

Die Stärke der Outputs ergibt sich, indem man für jede Synapse die Stärke der Inputkomponente mit dem Gewicht an dieser Vektorposition multipliziert. Daher ist die Outputstärke das Skalarprodukt aus dem Inputvektor und dem Gewichtsvektor des Neurons. Dies gilt sowohl für reale Neuronen als auch für künstliche Neuronen.

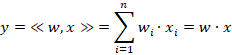

Für einen Inputvektor x und einen Gewichtsvektor w berechnet sich das Skalarprodukt y gemäß der Formel

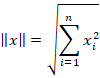

Jeder Vektor mit n Komponenten ist ein Vektor im n-dimensionalen Raum. Ordnet man jedem Vektor eine Norm zu, erfolgt der Übergang zum Hilbertraum. Die euklidische Norm entspricht der Länge des Vektors und ist definiert durch die Formel

Dividiert man einen Vektor x durch seine Norm, erhält man einen normierten Vektor x* mit der Länge 1:

![]()

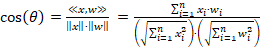

Durch die Normierung von Vektoren erhalten alle die Standardlänge 1. Sie unterscheiden sich dann nur noch durch ihre Richtung. Für zwei Vektoren, z. B. eine Vektor x und einen Gewichtsvektor w lässt sich der Winkel θ (Theta) über den Cosinus berechnen:

Die Ähnlichkeit zwischen zwei normierten Vektoren gleicher Dimension lässt sich über den Winkel beurteilen. Ist der Kosinus gleich 1, haben die Vektoren die gleiche Richtung und sind bis auf einen skalaren Faktor identisch. Ist der Kosinus gleich 0, stehen die Vektoren senkrecht aufeinander und sind völlig unterschiedlich.

Sind die Richtungen identisch, so sind die Vektoren bis auf einen reellen Faktor gleich. Ein kleiner Winkel steht für große Signalähnlichkeit. Ein rechter Winkel zeigt, dass beide Vektoren orthogonal zueinander sind und überhaupt keine Ähnlichkeit haben können.

Erlernen der Signalerkennung

Der Gewichtsvektor eines Neurons ermöglicht es, die Ähnlichkeit eines beliebigen Signalvektors mit seinem Gewichtsvektor zu beurteilen. Zum Vergleich dient das Skalarprodukt. Nun unterstellt man Neuronen die Lernfähigkeit. Daher muss es für das Neuron Möglichkeiten geben, die Erkennung eines Signals zu erlernen. Dies geschieht, in dem die Gewichtswerte des Neurons in einem Lernprozess den Signalvektor des Signals in seinen Gewichtsvektor übernimmt. Dies geschieht dies durch die schrittweise Annäherung der Gewichte an die Zielwerte. Bei künstlichen Neuronen verwendet man dazu mathematische Optimierungsverfahren (Gradientenverfahren, Backpropagation, Regularisierung). Bei biologischen Neuronen erfolgt das Erlernen des gewünschten Gewichtsvektors meist durch Hebbsches Lernen, aber auch durch Phänomene wie Langzeitpotenzierung (LTP) oder Langzeitdepression (LTD) und Spike-Timing-Zeit abhängige Plastizität (Spike-Timing-Dependent Plasticity, STDP). Eine Normierung des Gewichstvektors kann ein unbegrenztes Anwachsen der Gewichte verhindern, ohne die Signalerkennung zu stören.

Neuronale Netze bestehen aus vielen Neuronen und sind in der Lage, unterschiedlichste Signale zu erkennen. Reale neuronale Netze im Gehirn lernen durch biologische Algorithmen, künstliche durch mathematische Algorithmen. Die Fähigkeit zur Signalerkennung in Signalmengen ist die Grundlage der natürlichen und künstlichen Intelligenz. Die verschiedenen Verfahren werden nachfolgend immer dort erklärt, wo spezielle reale oder künstliche neuronale Netze in ihrem Aufbau und ihrer Funktionsweise vorgestellt werden.

Gewichtsmatrizen

Wenn mehrere oder viele Neuronen zu einem neuronalen Netz zusammengeschaltet werden, kann man ihre Gewichtsvektoren spaltenweise zu einer Matrix zusammenfassen, die als Gewichtsmatrix des Netzes bezeichnet wird. Mit der Anzahl der erlernbaren Signale oder Signalmuster erhöht sich nicht nur die Anzahl der Outputneuronen, es werden auch mehr Netzneuronen benötigt. Meist nimmt auch die Anzahl der Inputvektoren stark zu. In künstlichen neuronalen Netzen sind die Gewichte in den Matrizen reelle Zahlen, die auch negative Werte einnehmen können. In biologischen Netzen sind Feuerraten generell positiv, so dass die Gewichtsmatrizen durch positive reelle Zahlen dargestellt werden.

Monografie von Dr. rer. nat. Andreas Heinrich Malczan