Signaltheorie der Intelligenz

für das Human Brain Projekt der Europäischen Union

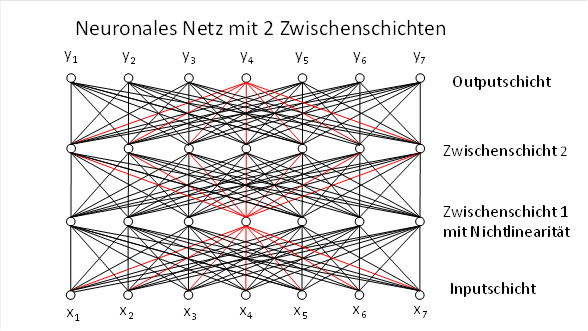

9 Die Einführung einer zweiten Zwischenschicht in neuronalen Netzen

Viele Algorithmen in der Künstlichen Intelligenz nutzen Netzstrukturen, die zwei Zwischenschichten besitzen und demzufolge durch drei Gewichtsmatrizen beschrieben werden. Dies hat eine ganz einfache Ursache:

- Die erste Schicht realisiert die Signalkonvergenz auf die Zwischenneuronen der ersten Zwischenschicht. So entstehen aus den Input-Elementarsignalen zunächst Komplexsignale, die von den Zwischenneuronen dieser Schicht repräsentiert werden.

- Die zweite Schicht zerlegt die Komplexsignale wieder in Elementarsignale, wobei auf Grund der dyadischen Projektion fehlende Elementarsignale des ursprünglichen Inputs ergänzt werden. Dies setzt voraus, dass auf jedes Zwischenneuron der ersten Zwischenschicht eine Nichtlinearität (Laterale Hemmung, ReLU, Softmax, Sigmoid, Tanh oder WTA) angewendet wird, um schwächere dyadische Produkte zu unterdrücken und stärkere hervorzuheben.

- Die dritte Netzschicht bildet aus den vervollständigten Elementarsignalen wieder neue Komplexsignale. Dies trifft vor allem bei KI-Algorithmen zu, bei denen es um die Erkennung von Komplexsignalen geht, wie bei Transformern oder State Space Modellen.

Intelligenz entsteht nicht zufällig. Sie beruht auf drei grundlegenden Verarbeitungsschritten, die in nahezu allen intelligenzstiftenden Systemen auftreten – unabhängig davon, ob es sich um Transformer, State Space Models oder biologische neuronale Netze handelt. Diese Systeme führen stets dieselbe Abfolge durch:

- Elementarsignale werden in Komplexsignale überführt.

- Komplexsignale werden in ihre Elementarsignale zerlegt, wobei fehlende Komponenten ergänzt und verrauschte Komponenten korrigiert werden.

- Die so vervollständigten Elementarsignale werden wieder zu neuen Komplexsignalen transformiert.

Da Komplexsignale vektoriell darstellbar sind und ihre Komponenten Elementarsignale bilden, führt die Arbeit mit ihnen zwangsläufig in die Algebra und die Matrizenrechnung. Deshalb benötigen biologische wie künstliche neuronale Netze drei unabhängige Gewichtsmatrizen, um diese drei Schritte abzubilden.

In Transformern heißen diese Matrizen Query, Key und Value. Sie definieren die drei linearen Abbildungen, aus denen der sogenannte Aufmerksamkeitsmechanismus (Attention) besteht. Doch hinter dieser Terminologie verbirgt sich ein universelles Prinzip, das weit über Transformer hinausreicht.

1. Universalsatz der dreifachen Projektion

Jedes intelligente Signalauswertungssystem benötigt drei unabhängige lineare Abbildungen, um Input, internen Zustand und Output miteinander zu verknüpfen.

Diese drei Abbildungen erfüllen universelle Funktionen:

-

- Input-Projektion

Eine Matrix überführt externe Signale in einen internen Zustands- oder Merkmalsraum.

- Transformer:

- State

Space Models:

- Biologie: Cortex → Basalganglien

-

- Zerlegung und Vervollständigung

Eine Matrix zerlegt Komplexsignale in ihre Elementarsignale und ergänzt fehlende Komponenten.

- Transformer:

- State

Space Models:

- Biologie: Basalganglien → Kleinhirn

-

- Output-Projektion

Eine Matrix transformiert die vervollständigten Elementarsignale wieder in neue Komplexsignale.

- Transformer:

- State

Space Models:

- Biologie: Kleinhirn → Thalamus/Cortex

Diese Dreifachstruktur ist architekturunabhängig. Sie tritt in diskreten, kontinuierlichen, rekurrenten und biologischen Systemen gleichermaßen auf.

Neuronale Systeme arbeiten im Originalbereich der Daten. Transformer dagegen arbeiten im Bildbereich. Dieser Unterschied ist technischer Art und historische gewachsen.

2. Theorem der Intelligenzentstehung

Intelligenz entsteht, wenn ein System Input in einen Zustand projiziert, diesen Zustand in seine Elementarsignale zerlegt und vervollständigt und daraus wieder neue Komplexsignale als Output projiziert. Dafür sind genau drei unabhängige Gewichtsmatrizen notwendig – und hinreichend.

Warum erzeugt ein dreistufiges System Intelligenz?

In der KI-Community wird diese Frage selten gestellt und praktisch nie beantwortet. Stattdessen verweist man auf den „Aufmerksamkeitsmechanismus“, der formal korrekt, aber erklärungsschwach ist. Die intelligenzstiftende Eigenschaft von Transformern und verwandten Architekturen ergibt sich jedoch aus einer einfachen, tiefen Struktur:

Drei lineare Abbildungen in Kombination mit Nichtlinearitäten reichen aus, um Muster zu bilden, zu zerlegen, zu vervollständigen und neu zu kombinieren – selbst dann, wenn sie im Input nur teilweise vorhanden sind.

Damit kommen wir zum zentralen Resultat.

3. Erstes Theorem der Minimalarchitektur intelligenzstiftender Systeme

Ein vollverbundenes Netz mit zwei Zwischenschichten und drei voneinander unabhängigen Gewichtsmatrizen Query (Q), Key (K) und Value (V)

-

:

Inputschicht – Elementarsignale → Zwischenschicht 1 –

Komplexsignale

:

Inputschicht – Elementarsignale → Zwischenschicht 1 –

Komplexsignale -

:

Zwischenschicht 1 – Komplexsignale → Zwischenschicht 2 –

Elementarsignale mit Signalvervollständigung

:

Zwischenschicht 1 – Komplexsignale → Zwischenschicht 2 –

Elementarsignale mit Signalvervollständigung -

:

Zwischenschicht 2 – Elementarsignale → Outputschicht – neue

Komplexsignale

:

Zwischenschicht 2 – Elementarsignale → Outputschicht – neue

Komplexsignale

und Hebb-artigem Lernen in den beiden Zwischenschichten sowie einer Nichtlinearität besitzt die folgenden Eigenschaften:

1. Komplexsignalbildung aus Elementarsignalen

Die erste Zwischenschicht lernt durch Hebb/LTP/LTD die

häufigsten Eingangsmuster

![]() als

Komplexsignale. Jedes Zwischenneuron repräsentiert ein solches Komplexsignal.

als

Komplexsignale. Jedes Zwischenneuron repräsentiert ein solches Komplexsignal.

2. Komplexsignalzerlegung mit Vervollständigung

Die zweite Zwischenschicht zerlegt jedes Komplexsignal wieder in seine Elementarsignale. Dabei ergänzt sie fehlende Komponenten und korrigiert verrauschte Anteile. Nötig ist jedoch, dass diejenigen dyadischen Summanden der Zwischenneuronen durch eine Nichtlinearität unterdrückt werden, deren Output zu schwach ist.

3. Mustervervollständigung

Wird der zweiten Zwischenschicht ein gestörter Input

![]()

präsentiert, so erzeugt das Netz den Output

![]()

der sich vom idealen Komplexsignal nur durch einen Skalarfaktor unterscheidet.

· Fehlende Komponenten werden ergänzt,

· überstarke Komponenten proportional reduziert,

· die Richtung des Komplexsignals bleibt erhalten.

Das System rekonstruiert also das vollständige Muster aus einem unvollständigen oder verrauschten Input.

4. Intelligenzstiftende Eigenschaft

Das System erzeugt vollständige Komplexsignale aus unvollständigen oder verrauschten Inputs. Es rekonstruiert, vervollständigt und stabilisiert Muster, die im Input nicht vollständig vorhanden sind.

Die ergänzten oder korrigierten Elementarsignale sind neue Informationen, die das System selbst erzeugt. Sie können in der nächsten Netzebene mit anderen Elementarsignalen zu neuen Komplexsignalen kombiniert werden, die im ursprünglichen Input ebenfalls nicht existierten.

Diese Fähigkeit zur Musterergänzung und Musterneubildung ist der Kern der Intelligenz.

Ob ein Signal als Elementarsignal oder als Komplexsignal zu interpretieren ist, bleibt oft Ansichtssache. Deshalb ist auch eine alternative Interpretation des Theorems der Intelligenzentstehung möglich.

4. Zweites Theorem der Intelligenzentstehung

Intelligenz entsteht, wenn ein System Komplexsignalinput in seine Elementarform transformiert und vervollständigt, diesen Zustand wieder seine Komplexform überträgt und daraus wieder neue Elementarsignale als Output erzeugt. Dafür sind genau drei unabhängige Gewichtsmatrizen und eine Nichtlinearität notwendig – und hinreichend.

Die Ursache für Intelligenz ist also nicht die Umwandlung der Elementarform in die Komplexform oder umgekehrt, sondern die dabei auftretende Signalergänzung, bei der vom System zwangsläufig neuer Input erschaffen wird, der in ursprünglichen Input gar nicht vorhanden war.

Literaturangabe:

Diese Erkenntnis gewann der Autor bereits im Jahre 2012 in seiner Monografie „Theorie der neuronalen Schaltung des Gehirns und des analytischen Denkens“, im Kapitel „Teil 2.15. Die Entstehung von Bewusstsein und Denken als systemtheoretische Realität“, veröffentlich unter ISBN 978-3-00-037458-6 sowie im Internet unter dem Link https://www.andreas-malczan.de/Monografie_Teil_1_und_2.html im Kapitel https://www.andreas-malczan.de/teil-2-15.html.

Monografie von Dr. rer. nat. Andreas Heinrich Malczan